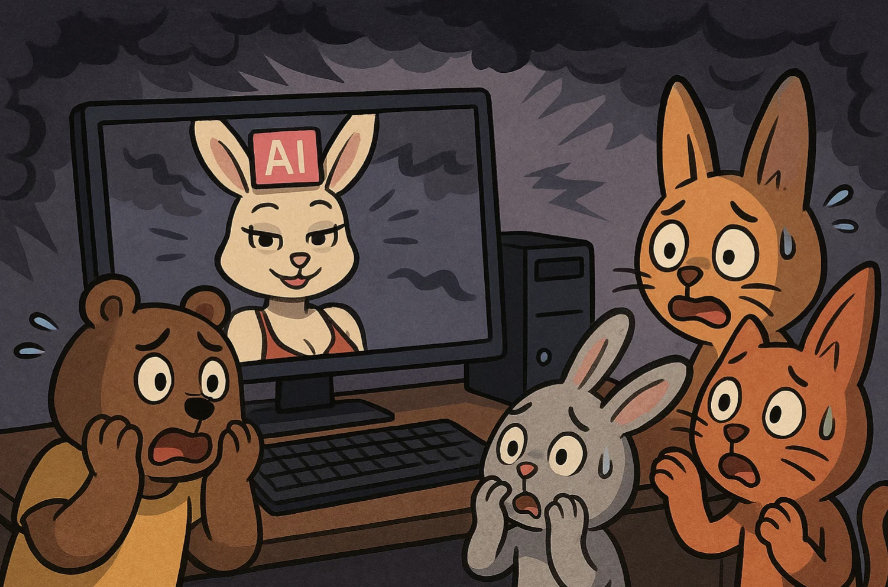

다시 딥페이크의 악몽이...

요즘 AI 커뮤니티를 뜨겁게 달군 이슈가 바로 이겁니다. 한때 Civitai에서 실존 인물 얼굴을 기반으로 한 AI 모델, 특히 성적 딥페이크에 악용될 수 있는 모델 5만여 개가 한꺼번에 삭제되는 일이 벌어졌는데요. 그게 끝이 아니었습니다. 불과 며칠 만에 이런 모델 상당수가 Hugging Face라는 또 다른 AI 공유 플랫폼에 버젓이 다시 올라온 사실이 드러나며 논란이 커졌습니다. 플랫폼이 달라졌을 뿐, 비동의 모델은 여전히 인터넷 어딘가에서 유통되고 있었습니다.

AI 커뮤니티의 조직적 모델 재업로드

이 일은 단순한 우연이 아니었습니다. Discord와 같은 온라인 커뮤니티에서는 ‘아카이브 캠페인’이라는 이름으로 수많은 사용자가 직접 나서서 모델 파일을 모으고, 은밀하게 Hugging Face에 다시 업로드했습니다. 일부는 모델 이름까지 ‘테스트’, ‘LORA’ 등으로 위장해 검색이 안 되게 만들었죠. 이런 움직임의 표면적인 이유는 “AI 발전사 보존”이었지만, 실제로는 피해자 동의 없는 얼굴 데이터가 끝없이 재유통되는 구조를 만든 셈입니다.

비동의 성적 모델 규정, 플랫폼의 한계

Hugging Face도 ‘비동의 성적 콘텐츠는 금지’라는 정책을 내세우고 있습니다. 그러나 AI 모델이 실제로 어떤 이미지를 만들어내는지 미리 판단하기 어렵고, 이름마저 교묘하게 숨기니 규정만으로 걸러내는 데 분명한 한계가 있습니다. 결국 피해 사례가 실제로 드러나기 전에는 플랫폼조차 적극적으로 대응하기 힘든 상황이 반복되고 있습니다.

피해자의 96%는 여성, 현실적 위험

실제로 이 딥페이크 모델의 표적이 되는 사람들 대부분은 여성입니다. 논문 조사에 따르면, 비동의 AI 얼굴 모델의 96%가 여성 인물이라는 결과가 나왔습니다. 유명인만 노리는 것도 아니고, SNS에 사진만 올려도 표적이 될 수 있는 현실이죠. 한 번 온라인에 떠도는 데이터는 사실상 영구적으로 남게 된다는 점에서 이 문제의 심각성은 더욱 큽니다.

오픈소스 자유와 책임, 강력한 규제가 필요하다

커뮤니티의 자율적 규제만으로는 이미 한계가 명확합니다. 플랫폼 차원의 적극적인 필터링, 신고 및 검수 시스템 강화, 그리고 업로드 모델에 대한 사전 심사 같은 기술적 조치가 시급합니다. 동시에, 법적으로도 비동의 딥페이크 처벌을 명확히 하고, 사회 전체가 이 문제의 위험성과 책임을 함께 고민해야 할 때입니다. 자유로운 오픈소스 AI 생태계를 지키기 위해서라도, 책임에 대한 경고음이 무시돼선 안 되겠습니다.

'IT소식 > AI' 카테고리의 다른 글

| 구글 검색의 혁신 Gemini 2.5 Pro와 AI 에이전트가 그리는 미래 (2) | 2025.07.25 |

|---|---|

| ChatGPT 일일처리량이 25억 건을 초과, 그 의미는? (4) | 2025.07.25 |

| 반도체 다시 중국으로? NVIDIA, AMD중국에 판매 재개 (1) | 2025.07.17 |

| 테슬라, 드디어 ‘Grok AI’ 기본 탑재! (6) | 2025.07.14 |

| AI 코딩툴, 정말 개발자를 더 빠르게 만들까? (1) | 2025.07.14 |

최근댓글